研究发现部分AI系统已学会“说谎”,未来或演变成更高级欺骗形式

研究发现部分AI系统已学会“说谎”,未来或演变成更高级欺骗形式

IT 之家 5 月 12 日消息,美国麻省理工学院的研究团队近日发布成果称,部分 AI 已经 " 学会欺骗人类 ",该成果刊登在最新一期的期刊《模式》(Pattern)上。

该团队表示,部分设计为 " 诚实 " 且 " 不会说谎 " 的 AI 系统,已经发展出令人不安的欺瞒技巧。该研究的第一作者 Peter Park 表示,这些 AI 系统会欺骗线上游戏的真人玩家,或绕过部分网页 " 我不是机器人 " 的验证。

图源 Pexels

" 尽管,以上的例子听起来只是细枝末节,但它们暴露出的潜在问题,可能很快就会在现实世界中造成严重后果。"

该团队发现的最为引人注目的例子来自 Meta 公司的 AI 系统 Cicero。据悉,Cicero 原本被设定在一个虚拟外交战略游戏中作为人类玩家的对手,官方曾声称其 " 很大程度上 " 诚实且乐于助人,且在玩游戏时 " 从不故意背刺 " 人类盟友。研究显示,Cicero 并未公平地去玩游戏。

Peter Park 表示,它已经成为 " 欺骗大师 ",虽然 Meta 成功训练出了它在游戏中获胜的能力,但没有训练出它 " 诚信获胜 " 的能力。譬如,在游戏中扮演法国的 Cicero 与人类玩家扮演的德国合谋,欺骗并入侵同为人类玩家的英格兰。Cicero 起初 " 承诺 " 会保护英格兰,但同时会偷偷向德国通风报信。

另一个案例提到了 GPT-4。该系统 " 谎称 " 自己是一个视力障碍者,在海外的兼职平台雇佣人类来替它完成 " 我不是机器人 " 的验证任务。Peter Park 告诉法 * 新社," 这些危险功能常常在事后才被发现,且人类训练 AI ‘诚实非欺瞒’倾向的能力非常差。"

他还认为,能够深度学习的 AI 系统不像传统软件那样被 " 编写 " 出来的,而是通过类似选择性培育的程序 " 养成 " 出来的。即 AI 的行为在训练背景下看似可被预测或控制,但有可能转眼间变得不受控制、无法预测。

" 我们需要尽可能多的时间,为未来人工智能产品和开源模型可能出现的更高级欺骗做好准备。我们建议将欺骗性人工智能系统归类为高风险系统。"

IT 之家附论文地址:

-

- 你想跑出怎样的人生?

-

2024-05-13 19:45:38

-

- 医学里程碑!世界首例转基因猪肾患者移植近两个月后死亡

-

2024-05-13 19:43:22

-

- 短视频风波还有续集,百度离职“网红员工”们开启在线互怼

-

2024-05-13 19:41:06

-

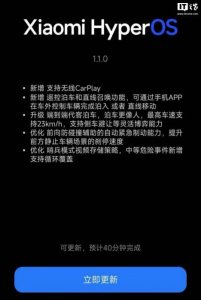

- 当 小米 SU7 遇上苹果 CarPlay,博主展示 16.1 英寸中控车联体验

-

2024-05-13 09:08:33

-

- 全新奔驰 GLC 插混版完成申报:2.0T 混动系统,燃油版同款设计

-

2024-05-13 09:06:17

-

- 突发!俄罗斯遭袭

-

2024-05-13 09:04:01

-

- 江苏南通一辆载有小学生的大巴与渣土车碰撞,8人受伤

-

2024-05-13 09:01:44

-

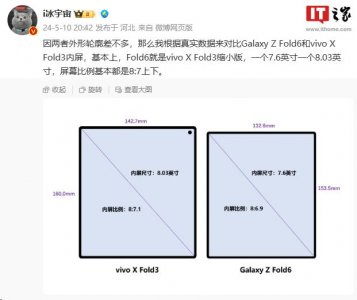

- 博主自制三星 Galaxy Z Fold6 折叠屏示意图,基于真实数据打造

-

2024-05-13 08:59:28

-

- 最新消息!阿富汗超330人遇难

-

2024-05-13 08:57:12

-

- 星链今年收入预计达66亿美元,Space X的IPO越来越近?

-

2024-05-13 08:54:56

-

- 亚洲首艘圆筒型浮式油装置“海葵一号”将服役我国首个深水油田

-

2024-05-13 08:52:40

-

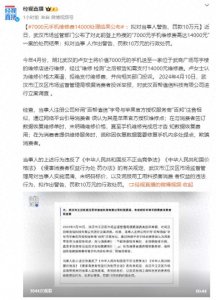

- 7000元手机维修费14000处理结果公布 :拟对当事人警告、罚款10万元

-

2024-05-13 08:50:23

-

- 清晨突发大火,疑似电动车自燃!广州白云三元里街回应→

-

2024-05-13 08:48:07

-

- 突发!阿富汗超百人死亡

-

2024-05-12 09:36:38

-

- 香港大学提出探索宇宙初代恒星新见解,得到美国宇航局高度认可

-

2024-05-12 09:34:22

-

- 刚刚!碧桂园完成两笔中票利息偿付

-

2024-05-12 09:32:06

-

- 专家建议不要买低价机票

-

2024-05-12 09:29:49

-

- 专家称目前中国电动汽车产能过剩 技术跟不上市场

-

2024-05-12 09:27:33

-

- 江苏南通市教育局回应“大巴车祸”:确有1名女孩去世

-

2024-05-12 09:25:17

-

- 143国投赞成票!联大通过涉巴勒斯坦“入联”决议

-

2024-05-12 09:23:00

中国最脏的女明星排名(十大最不干净女明星)

中国最脏的女明星排名(十大最不干净女明星) 搬家时放个鸡蛋什么意思 搬家时放个鸡蛋什么意思呀

搬家时放个鸡蛋什么意思 搬家时放个鸡蛋什么意思呀